Khi việc sử dụng AI ngày càng phổ biến, bảo mật vẫn luôn là mối quan tâm hàng đầu, và chúng ta thường nghe rằng các tổ chức lo ngại về những rủi ro có thể đi kèm với việc áp dụng AI trong doanh nghiệp một cách nhanh chóng. Chính vì vậy, Google Cloud cam kết hỗ trợ khách hàng xây dựng và triển khai AI một cách an toàn, đảm bảo tuân thủ và bảo mật. Mới đây, Google đã giới thiệu một giải pháp mới giúp người dùng giảm thiểu rủi ro trong suốt vòng đời AI. Đó chính là AI Protection, một tập hợp các tính năng được thiết kế để bảo vệ khối lượng công việc AI và dữ liệu trên các đám mây cũng như các mô hình — bất kể nền tảng nào đang sử dụng.

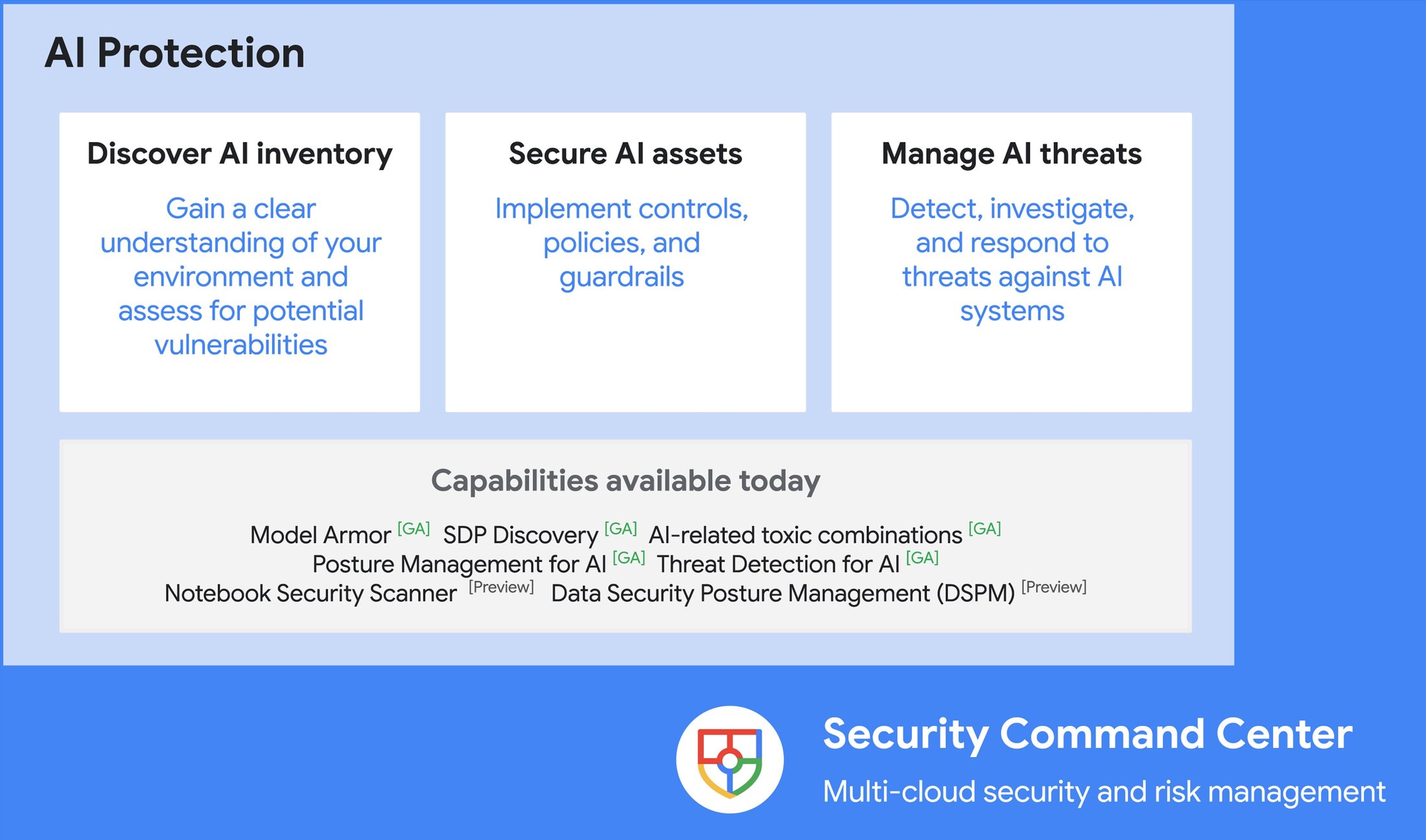

AI Protection giúp các đội nhóm quản lý rủi ro AI một cách toàn diện bằng cách:

- Phát hiện tài nguyên AI trong môi trường của bạn và đánh giá các lỗ hổng tiềm ẩn

- Bảo vệ tài sản AI bằng các kiểm soát, chính sách và cơ chế bảo vệ

- Quản lý các mối đe dọa đối với hệ thống AI thông qua khả năng phát hiện, điều tra và phản ứng

AI Protection được tích hợp với Security Command Center (SCC), nền tảng quản lý rủi ro đa đám mây của Google, giúp các nhóm bảo mật có được cái nhìn tập trung về trạng thái bảo mật AI. Nhờ đó, người dùng có thể quản lý rủi ro AI một cách toàn diện trong bối cảnh chung với các rủi ro đám mây khác.

Khám phá tài nguyên AI

Quản lý rủi ro AI hiệu quả bắt đầu bằng việc hiểu rõ AI đang được sử dụng ở đâu và như thế nào trong môi trường của bạn. Các tính năng của chúng giúp tự động phát hiện và lập danh mục tài nguyên AI, bao gồm việc sử dụng mô hình, ứng dụng và dữ liệu — cũng như mối quan hệ giữa chúng.

Hiểu được loại dữ liệu nào hỗ trợ ứng dụng AI và cách nó đang được bảo vệ là điều tối quan trọng. Sensitive Data Protection (SDP) hiện mở rộng khả năng phát hiện dữ liệu tự động cho tập dữ liệu Vertex AI, giúp người dùng hiểu rõ độ nhạy cảm của dữ liệu cũng như các loại dữ liệu được sử dụng để huấn luyện và tinh chỉnh mô hình. SDP cũng có thể tạo hồ sơ dữ liệu cung cấp thông tin chuyên sâu hơn về loại dữ liệu và mức độ nhạy cảm của dữ liệu đào tạo.

Sau khi xác định vị trí dữ liệu nhạy cảm, AI Protection có thể sử dụng phương thức bảo mật an ninh mạng ảo của Security Command Center’s để phát hiện các tổ hợp dữ liệu độc hại liên quan đến AI và các hành trình tiềm năng mà kẻ tấn công có thể khai thác để xâm phạm dữ liệu quan trọng này. Đồng thời, nó sẽ đề xuất các biện pháp khắc phục lỗ hổng và điều chỉnh trạng thái bảo mật phù hợp.

Bảo vệ tài sản AI

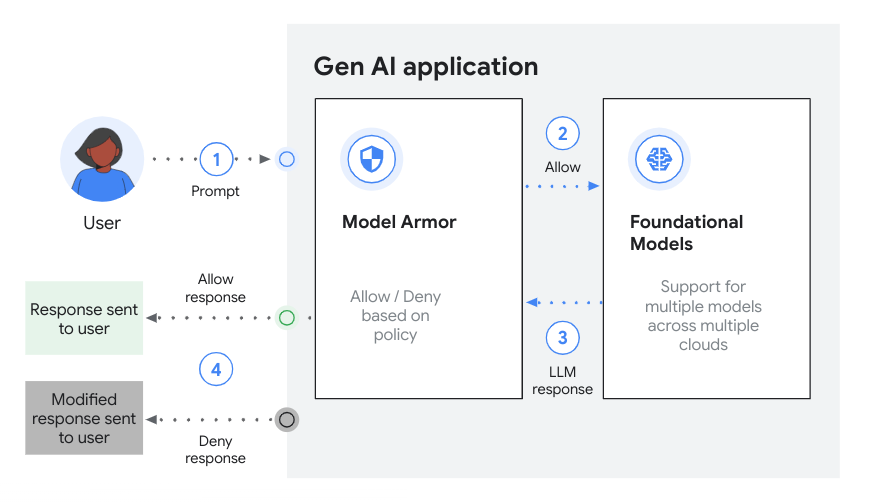

Model Armor, một tính năng cốt lõi của AI Protection, hiện đã được phát hành rộng rãi. Công cụ này giúp bảo vệ chống lại prompt injection, jailbreak, mất dữ liệu, URL độc hại, và nội dung không phù hợp. Model Armor hỗ trợ nhiều mô hình AI trên các nền tảng đám mây khác nhau, đảm bảo khách hàng có được sự bảo vệ nhất quán — ngay cả khi họ thay đổi nền tảng trong tương lai.

Hiện tại, các nhà phát triển có thể dễ dàng tích hợp Model Armor vào ứng dụng thông qua REST API hoặc Apigee. Sắp tới, khách hàng sẽ có thể triển khai Model Armor trực tiếp mà không cần thay đổi ứng dụng thông qua tích hợp với Vertex AI và các sản phẩm Cloud Networking.

Các tổ chức có thể sử dụng AI Protection để tăng cường bảo mật cho ứng dụng Vertex AI bằng cách thiết lập các chính sách bảo mật trong Security Command Center. Những chính sách này được thiết kế dựa trên kiến thức chuyên sâu về kiến trúc Vertex AI, giúp cấu hình tài nguyên an toàn và ngăn chặn các thay đổi trái phép.

Quản lý các mối đe dọa AI

AI Protection tận dụng thông tin tình báo bảo mật từ Google và Mandiant để bảo vệ hệ thống AI của bạn. Các công cụ phát hiện trong Security Command Center có thể giúp xác định các nỗ lực truy cập ban đầu, leo thang đặc quyền, và cố gắng duy trì quyền kiểm soát đối với khối lượng công việc AI.

Sắp tới, AI Protection sẽ có thêm các bộ phát hiện mới dựa trên thông tin tình báo tiên tiến, giúp phát hiện và quản lý các mối đe dọa thời gian chạy, chẳng hạn như hijacking mô hình nền tảng.

Dr. Grace Trinidad, Giám đốc nghiên cứu tại IDC, nhấn mạnh: “Khi các giải pháp AI trở nên phổ biến hơn, bảo vệ hệ thống AI là điều tối quan trọng và vượt xa khái niệm bảo vệ dữ liệu thông thường. Bảo mật AI đòi hỏi một chiến lược toàn diện, bao gồm tính toàn vẹn của mô hình, nguồn gốc dữ liệu, tuân thủ quy định, và quản trị mạnh mẽ.”

“Những giải pháp bảo mật rời rạc có thể để lại những lỗ hổng quan trọng, khiến tổ chức dễ bị tấn công đối kháng hoặc nhiễm độc dữ liệu, đồng thời gia tăng áp lực lên đội ngũ bảo mật. Một phương pháp tiếp cận toàn diện theo vòng đời AI giúp tổ chức giảm thiểu hiệu quả các rủi ro đa chiều do AI tạo ra và quản lý khối lượng công việc bảo mật ngày càng mở rộng. Với cách tiếp cận tổng thể này, Google Cloud giúp đơn giản hóa và nâng cao trải nghiệm bảo mật AI cho khách hàng.”

Kết hợp AI Protection với chuyên môn thực tiễn

Danh mục Dịch vụ Tư vấn Bảo mật AI của Mandiant cung cấp các dịch vụ hỗ trợ tổ chức đánh giá và triển khai các biện pháp bảo mật AI mạnh mẽ trên nhiều nền tảng đám mây. Đội ngũ chuyên gia có thể đánh giá bảo mật AI từ đầu đến cuối và đề xuất các phương pháp để tăng cường khả năng bảo vệ hệ thống.

Ngoài ra, Mandiant cũng cung cấp dịch vụ red teaming dành cho AI, được xây dựng dựa trên những cuộc tấn công AI thực tế, giúp tổ chức chủ động kiểm tra và củng cố hệ thống trước các mối đe dọa tiên tiến.

Xây dựng trên nền tảng bảo mật vững chắc

Khách hàng có thể tận dụng cơ sở hạ tầng bảo mật của Google Cloud để xây dựng và vận hành khối lượng công việc AI. Nền tảng đám mây của Google được thiết kế theo nguyên tắc bảo mật ngay từ đầu (secure-by-design) và bảo mật mặc định (secure-by-default), với nhiều lớp bảo vệ, mã hóa và kiểm soát chuỗi cung ứng phần mềm nghiêm ngặt.

Đối với khách hàng có khối lượng công việc AI tuân theo quy định pháp lý, chúng tôi cung cấp:

- Assured Workloads – giúp tạo môi trường kiểm soát với các chính sách bảo mật nghiêm ngặt, đảm bảo vị trí dữ liệu và mã hóa do khách hàng quản lý.

- Audit Manager – cung cấp bằng chứng về tuân thủ các tiêu chuẩn AI và quy định pháp lý đang phát triển.

- Confidential Computing – bảo vệ dữ liệu trong toàn bộ quá trình xử lý, giảm thiểu rủi ro truy cập trái phép, ngay cả với người dùng có đặc quyền hoặc tác nhân độc hại trong hệ thống.

Ngoài ra, đối với các tổ chức muốn phát hiện việc sử dụng AI trái phép (shadow AI) trong doanh nghiệp, Chrome Enterprise Premium cung cấp khả năng giám sát hoạt động của người dùng cuối, đồng thời ngăn chặn rò rỉ dữ liệu nhạy cảm, dù là vô tình hay cố ý, trong các ứng dụng AI tổng quát.

Tìm hiểu thêm về Google Cloud cũng như các biện pháp bảo mật hiện đại trên nền tảng đám mây này tại đây!