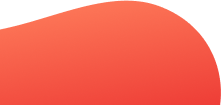

Năm 2025 đánh dấu một cột mốc quan trọng đối với DigitalOcean – không chỉ bởi số lượng sản phẩm và tính năng được ra mắt nhiều nhất từ trước đến nay, mà còn bởi việc củng cố rõ ràng tầm nhìn về kỷ nguyên tiếp theo của điện toán đám mây và AI. DigitalOcean đã đồng hành cùng khách hàng trong việc triển khai suy luận (inference) ở quy mô lớn, ra mắt các sản phẩm mới, tăng cường gắn kết cộng đồng cả trực tiếp lẫn trực tuyến, và xây dựng Inference Cloud—nền tảng giúp các doanh nghiệp số hóa và doanh nghiệp AI-native tích hợp liền mạch quy trình AI và đám mây trên một nền tảng hợp nhất.

DigitalOcean thấu hiểu rằng khách hàng đang tập trung vào những ưu tiên giống mình: đổi mới với tốc độ cao, tích hợp AI vào ứng dụng, và thích ứng trước những biến động nhanh chóng của ngành. Các nhà phát triển và doanh nghiệp số không tìm kiếm sự phức tạp; họ cần khả năng xây dựng nhanh, mở rộng dễ dàng, và sáng tạo với AI mà không tiêu tốn thêm nguồn lực hay thời gian. Mọi nỗ lực trong năm 2025 đều được định hướng bởi những nguyên tắc đó—và DigitalOcean sẵn sàng chia sẻ các kế hoạch cho năm 2026 trong thời gian tới.

AI được xây dựng cho nhu cầu của doanh nghiệp

AI đã vượt qua một ngưỡng quan trọng trong năm 2025, trở thành nền tảng cốt lõi không chỉ đối với các tập đoàn lớn, mà còn với các doanh nghiệp số hóa và startup. Báo cáo nghiên cứu Currents sắp công bố đã xác nhận xu hướng này: 52% tổ chức đang tích cực triển khai các giải pháp AI, tối ưu hiệu năng AI, hoặc xem AI là thành phần trung tâm trong chiến lược kinh doanh—so với 35% vào năm 2024.

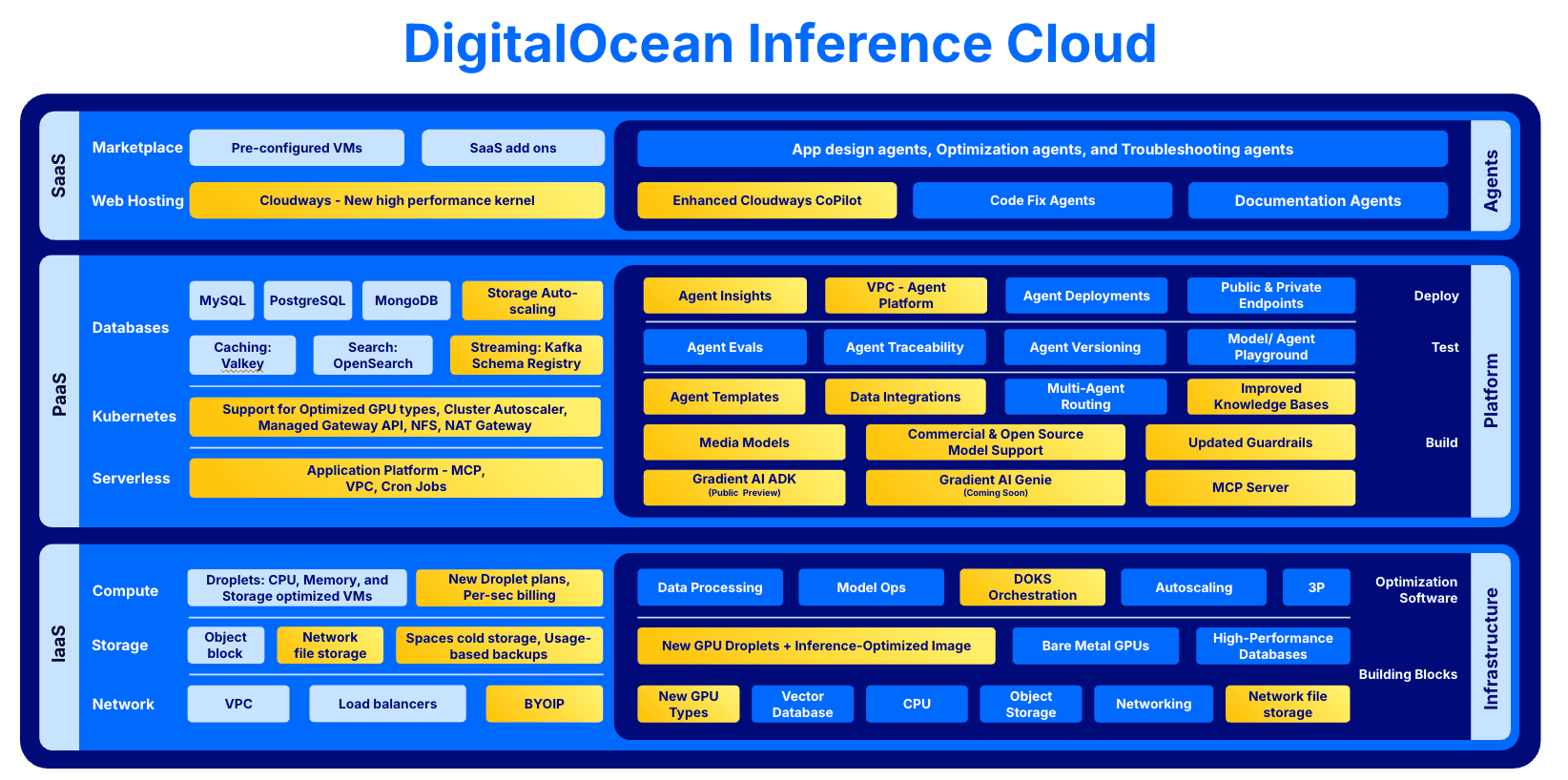

Trong năm 2025, sứ mệnh của DigitalOcean là đơn giản hóa và phổ cập AI cho cộng đồng xây dựng trên nền tảng đám mây. Với mục tiêu đó, DigitalOcean đã ra mắt Gradient AI Platform vào tháng 1 và nhanh chóng mở rộng năng lực của nền tảng này xuyên suốt năm. Gradient AI Platform cho phép các đội ngũ:

- Xây dựng AI agent có khả năng mở rộng: Triển khai các công cụ AI được thiết kế theo nhu cầu cụ thể thông qua LLM bên thứ ba được lưu trữ sẵn, quy trình RAG và function calling.

- Tích hợp liền mạch vào quy trình làm việc: Nhúng agent trực tiếp vào ứng dụng thông qua API hoặc plugin chatbot.

- Áp dụng guardrails linh hoạt: Sử dụng các lớp kiểm soát có thể tùy chỉnh nhằm lọc và hạn chế nội dung độc hại.

- Tối ưu hiệu quả triển khai: Chuyển đổi mượt mà từ giai đoạn thử nghiệm sang các giải pháp sẵn sàng vận hành ở môi trường production.

- Khai thác serverless inference: Truy cập trực tiếp và linh hoạt vào các mô hình hàng đầu trong ngành, không cần quản lý hạ tầng phức tạp.

Song song đó, DigitalOcean tiếp tục mở rộng năng lực Inference Cloud thông qua việc ra mắt các GPU thế hệ mới như NVIDIA H200 và AMD MI300X, cùng các dòng máy RTX 400 và L40s—phù hợp cho các nhóm đang thử nghiệm và phát triển nguyên mẫu. Nền tảng cũng được bổ sung hỗ trợ DigitalOcean Kubernetes cho GPU Droplets, cho phép khách hàng triển khai các workload tăng tốc GPU trên DigitalOcean Managed Kubernetes với các loại GPU Droplet mới nhất.

Khép lại chuỗi nâng cấp hạ tầng, DigitalOcean đã đưa vào vận hành trung tâm dữ liệu tối ưu cho AI tại Atlanta, được thiết kế hiện đại nhằm đáp ứng nhu cầu mở rộng nhanh chóng của năng lực GPU và củng cố nền móng cho Inference Cloud trong giai đoạn tăng trưởng tiếp theo.

Thế hệ tiếp theo của Droplets, mạng lưới và hệ thống tài khoản

DigitalOcean được xây dựng trên niềm tin rằng hạ tầng đám mây cần dễ dự đoán, minh bạch và triển khai nhanh chóng—và triết lý đó bắt đầu từ Droplet, dòng máy ảo đặc trưng của nền tảng. Trong năm 2025, DigitalOcean đã mở rộng đáng kể năng lực của Droplets và công bố những cải tiến quan trọng nhằm đáp ứng các yêu cầu hiện đại của Inference Cloud và các workload AI:

- Tính phí theo giây cho Droplets — mô hình định giá chính xác, phù hợp với các workload linh hoạt và hiện đại.

- Gói Dedicated Droplet mới — mang lại hiệu năng ổn định, nhất quán cho các kịch bản đòi hỏi hiệu suất cao.

- Bring Your Own IP (BYOIP) — đơn giản hóa quá trình di chuyển hạ tầng và giảm thiểu gián đoạn.

- VPC NAT Gateway — kiến trúc gọn gàng hơn, bảo mật hơn cho các hệ thống đám mây hiện đại.

Song song với đó, DigitalOcean cũng triển khai các nâng cấp quan trọng về bảo mật và quản trị tài khoản, bao gồm Single Sign-On (SSO) để tăng cường an toàn đăng nhập, cùng DigitalOcean Organizations—lớp quản lý tài khoản toàn diện giúp kiểm soát chi phí tốt hơn và xây dựng cấu trúc tài khoản trực quan, linh hoạt.

Đây không chỉ là những điều chỉnh mang tính gia tăng. Những cải tiến này phản ánh cam kết của DigitalOcean trong việc đồng bộ hóa đám mây với cách các nhà phát triển xây dựng sản phẩm ngày nay, đồng thời đảm bảo khách hàng luôn có trong tay các công cụ cần thiết để vận hành, mở rộng và khai thác hiệu quả Inference Cloud.

Lưu trữ được nâng cấp cho các workload quy mô lớn

Khi ứng dụng bước vào giai đoạn trưởng thành, nhu cầu lưu trữ cũng thay đổi theo. Trong năm 2025, DigitalOcean đã mở rộng năng lực lưu trữ để tăng trưởng song hành cùng khách hàng, mà không tạo thêm gánh nặng quản trị hệ thống—một yêu cầu then chốt đối với các workload của Inference Cloud.

Các giải pháp lưu trữ mới được ra mắt bao gồm:

- Cold Storage — lưu trữ dài hạn với chi phí thấp cho các dữ liệu ít được truy cập.

- Network File Storage (NFS) — hiệu năng cao, tối ưu cho các workload AI và suy luận.

- Sao lưu theo mức sử dụng (usage-based backups) — đơn giản, linh hoạt và tiết kiệm chi phí.

- Tự động mở rộng dung lượng lưu trữ cho cơ sở dữ liệu được quản lý — đảm bảo hệ thống luôn sẵn sàng khi quy mô tăng trưởng.

Những nâng cấp này xuất phát trực tiếp từ nhu cầu thực tế của khách hàng, nhằm giúp họ quản lý dữ liệu và bảo vệ hệ thống hiệu quả hơn khi quy mô vận hành ngày càng mở rộng.

Hệ sinh thái AI mở rộng phạm vi tiếp cận

Không một nền tảng nào tồn tại độc lập. DigitalOcean chủ động hợp tác với các đối tác hàng đầu trong lĩnh vực AI và đám mây để mang đến những đổi mới tiên tiến nhất cho khách hàng. Trong năm qua, DigitalOcean đã công bố AI Ecosystem—một hệ sinh thái toàn diện phục vụ phát triển AI, bao gồm GPU từ AMD và NVIDIA, cùng quyền truy cập vào các mô hình tiên tiến từ những tên tuổi như OpenAI, DeepSeek, Meta, Mistral và fal.ai.

Hệ sinh thái startup AI được tái cấu trúc cũng cho phép DigitalOcean đồng hành và hỗ trợ các startup AI trong suốt hành trình tăng trưởng của họ.

Bên cạnh đó, DigitalOcean đã trực tiếp lắng nghe chia sẻ từ cộng đồng khách hàng tại các sự kiện DigitalOcean Deploy ở Austin và London, nơi nhiều doanh nghiệp—trong đó có Traversal—đang mở rộng quy mô thành công nhờ các sản phẩm của DigitalOcean như Gradient AI GPU Droplets và Serverless Inference trong khuôn khổ Inference Cloud.

2026 là năm của Inference Cloud

Năm 2025 tập trung vào việc xây dựng nền móng vững chắc thông qua hàng loạt cập nhật quan trọng về AI và đám mây, đồng thời mở rộng quan hệ đối tác nhằm phục vụ tốt hơn các doanh nghiệp đang tăng trưởng nhanh trên nền tảng DigitalOcean. Tuy nhiên, năm 2026 mới là thời điểm mọi yếu tố hội tụ.

Với nền tảng đã được hoàn thiện, DigitalOcean sẵn sàng bước vào giai đoạn mở rộng mạnh mẽ của Inference Cloud, bao gồm kế hoạch ra mắt GPU NVIDIA HGX™ B300 trong thời gian tới. Trong năm 2026, DigitalOcean đặt mục tiêu hỗ trợ các khách hàng quy mô lớn hơn thông qua các workflow AI-native toàn diện hơn, khả năng tích hợp chặt chẽ hơn giữa các sản phẩm, cùng việc mở rộng chiều sâu hợp tác trong toàn bộ hệ sinh thái AI và đám mây.

Song song đó, DigitalOcean tiếp tục tăng cường kết nối với cộng đồng khách hàng và nhà phát triển thông qua các sự kiện được tổ chức trên nhiều khu vực, khẳng định cam kết đồng hành dài hạn và thúc đẩy sự phát triển của Inference Cloud trong kỷ nguyên AI tiếp theo.

Tìm hiểu thêm: NLP vs NLU: Những Khác Biệt Và Cách Phối Hợp Với Nhau

Liên hệ ngay với đội ngũ CloudAZ để nhận được những tư vấn chuyên sâu phù hợp với với nhu cầu phát triển của doanh nghiệp bạn